MEA-EFFormer

MEA-EFFormer:基于增强特征Transformer的多尺度有效注意力算法及其在高光谱图像分类中的应用

主旨

考虑光谱与空间特征的深层联系

创新点

-

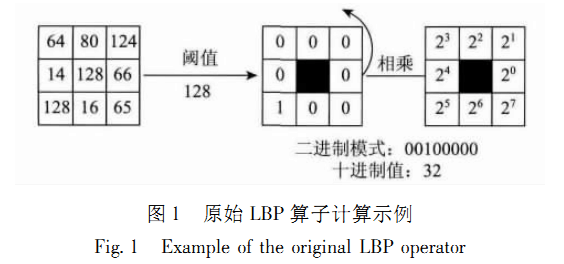

局部二进制模式(LBP)提取局部空间特征

该方法最早在1996年提出,是纹理分类和人脸识别领域的主要特征提取方法之一。

优势:

1)计算复杂度低;

2)无需训练学习;

3)光照不变性;

4)灰度不变性;

5)旋转不变性。

方法:以3×3矩阵中心点为阈值,四周比它大的或等于它的值设为1,比它小的设为0,从x轴的正方向出发逆时针转动,2的指数从0到7设计相同形状的3×3矩阵并将二进制转为十进制数字,两个矩阵相同位置的元素相乘,得到一个局部二进制模式。

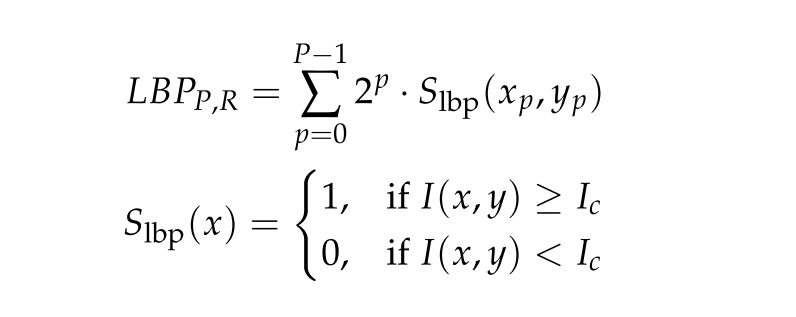

其中S_lbp是相邻像素的二进制位,I(x,y)是相邻像素的灰度值,并且I_c是中心像素的灰度值。P是邻域中像素的数量,R是邻域的半径,并且(x_p,y_p)是邻域中像素的坐标。

-

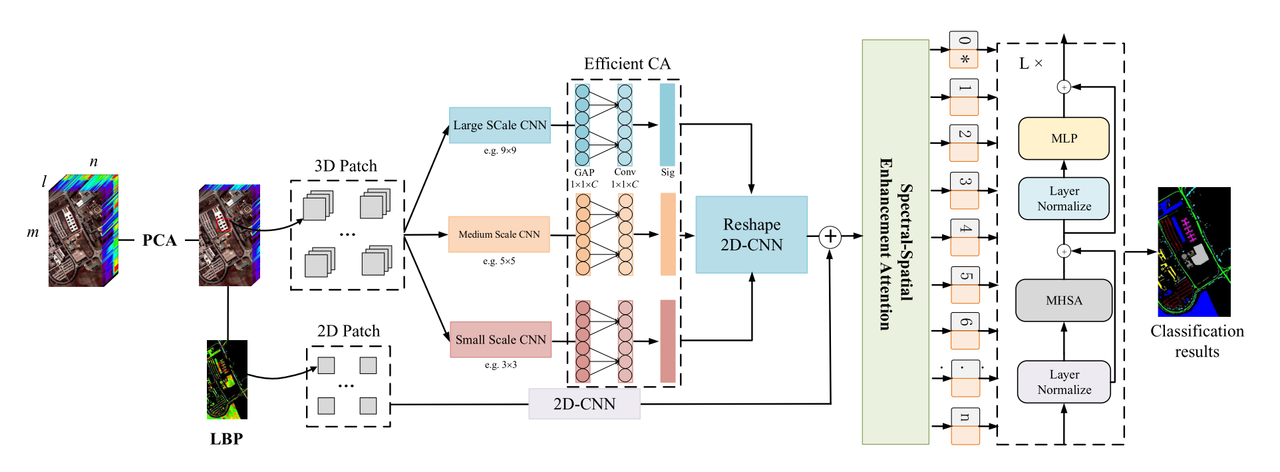

混合二维卷积(2D-CNN)和三维卷积(3D-CNN)提取局部特征,Transformer提取全局特征

引用一篇论文研究发现二维卷积擅长利用空间特征,但不擅长利用光谱信息;三维卷积同时擅长利用空间特征和光谱信息。介绍多篇论文中的混合卷积模型,要比单使用三维卷积的模型复杂度低,参数减少,增强分类能力等。

三维卷积方面使用多尺度卷积,即使用不同大小的卷积核在同一时刻分别进行卷积操作,之后改变形状在进行二维卷积,与之前二维卷积的信息进行残差相加。

网络结构核心

- 多尺度有效注意特征提取模块

- 光谱-空间特征增强注意模块

- Transformer编码器

主要贡献

- MEA-EFFormer是一个多尺度高效的注意力特征提取模块,它将高效的通道注意力机制与多尺度卷积相结合。它有利于挖掘光谱-空间信息中的细节,并解决了单尺度采样过程中细粒度特征丢失的问题。

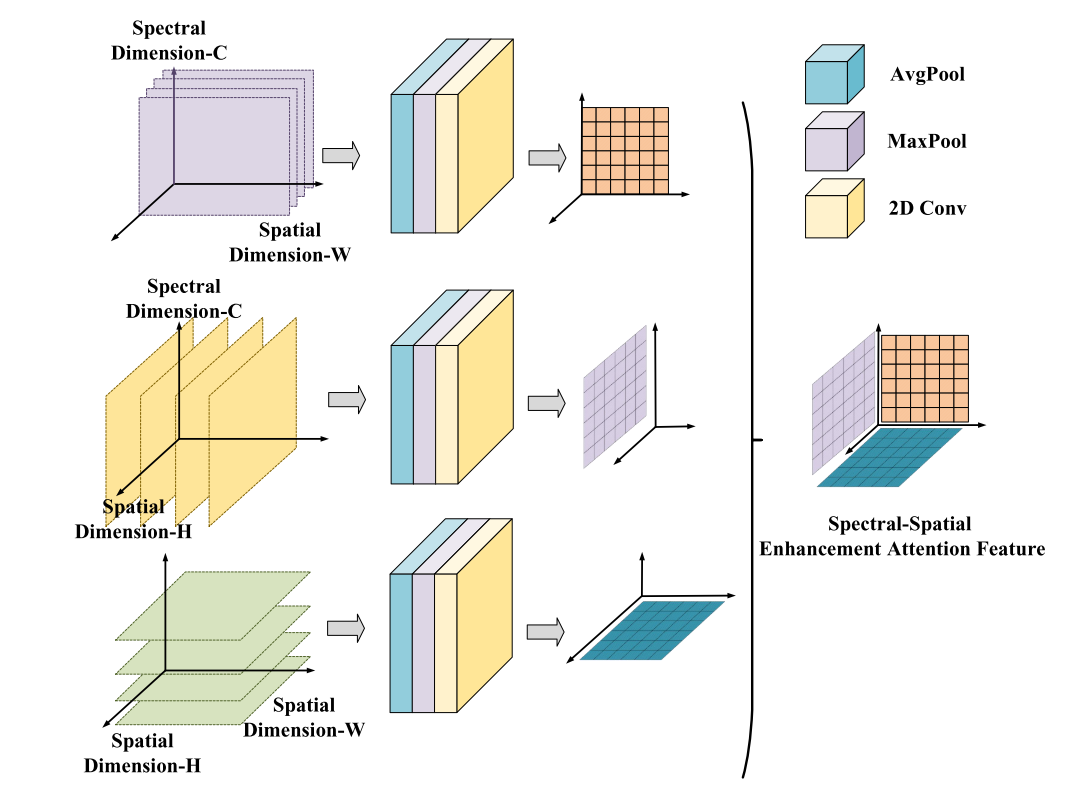

- MEA-EFFormer使用SSEA模块。该方法基于C-H、C-W和H-W三个方向,捕捉LBP的频谱-空间信息之间的依赖关系,细化特征的尺度,提高注意机制的感知能力。

- MEA-EFFormer的分类性能优于几种经典方法和SOTA方法。在所有三个知名数据集上的实验表明,该方法具有良好的分类性能。

网络模型图

-

主成分分析(PCA):对图像形状(m×n×l,长、宽、原始高光谱图像的所有波段数)保留最重要的波段,降维成图像形状(m×n×b,长、宽、PCA后的波段数)

优点:减少特征的维度,降低过拟合的风险

-

Eifficient CA(ECA,高效通道注意力):使用全局平均池化(GAP)将图像压缩成形状(1×1×C),在使用带有自适应卷积核的一维卷积操作(1×1卷积核)计算每个波段的权重,再引用sigmoid激活函数来映射0和1之间的权重

-

Spectral–Spatial Enhancement Attention(SSEA,光谱-空间增强注意力):

1、沿着H轴逆时针旋转90度,得到形状(W×H×C),再进行平均池化,最大池化,二维卷积操作;

2、沿着W轴逆时针旋转90度,得到形状( H×C×W),再进行平均池化,最大池化,二维卷积操作;

3、不旋转,原始形状(C×W×H),再进行平均池化,最大池化,二维卷积操作;

总结

在本文中,我们提出了一种方法称为多尺度有效的注意力和增强的特征Transformer(MEA-EFFormer)的高光谱图像分类。我们通过多尺度有效的注意特征提取模块获得进一步细化的频谱空间信息。然后将联合收割机的二维卷积特征与局部二值模式(LBP)空间信息相结合,有效地提高了特征的表示能力。然后,我们使用频谱-空间增强注意模块,使特征增强。最后,我们通过Transformer编码器对这些特征进行分类。

知识点

- 多尺度卷积(比如特征金字塔)的优势:

- 多尺度信息:可以在不同层级的网络中提取特征来获取多尺度信息。在目标检测任务中,目标可能以不同的尺寸出现在图像中,因此需要在不同尺度上进行检测和定位。通过合并不同层次的特征图,可以检测和识别不同尺寸的目标。

- 上下文信息:通过在不同的层级中提取特征,可以捕获更广泛的上下文信息。较深层次的特征通常对于全局语义信息具有较好的把握,而较浅层次的特征可以提供更多局部细节信息。通过多尺度卷积,算法可以在不同层级上同时利用全局和局部信息,从而更好地理解图像内容。

- 减少信息丢失:在深度卷积神经网络中,随着网络层数的增加,特征图的尺寸逐渐减小。这可能导致信息丢失,特别是对于较小目标或细节。通过融合多个尺度的特征,可以减少信息丢失的影响,提高网络的能力。