7 多层感知机

感知机

-

给定输入x,权重w,偏移b,感知机输出:

$$

y=l(<w,b>+b)\quad\quad\quad

l(x)=\begin{cases}

1, \quad x > 0\

-1, \quad other

\end{cases}

$$ -

二分类:-1或1

- 回归输出实数

- Softmax回归输出概率

-

感知机时一个二分类的模型

-

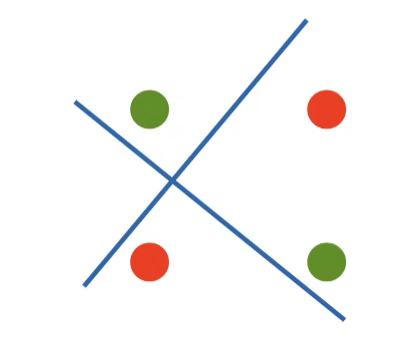

它不能拟合XOR函数,只能产生线性分割面,即一条线不能分开红绿球,随后产生多层感知机。

激活函数

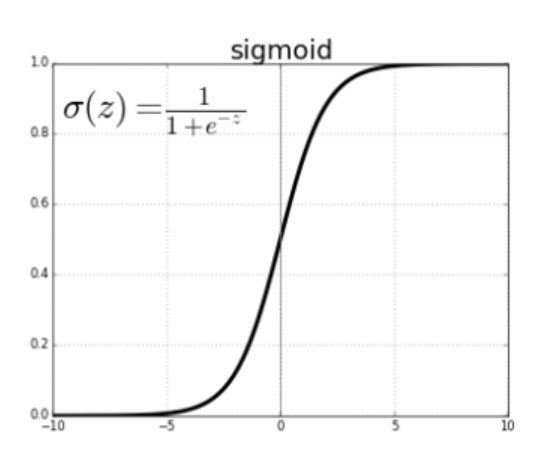

Sigmoid激活函数

$$

sigmoid (x)= \frac {1}{1+e^{-x}}

$$

-

投影到(0,1)区间,相当于二分法的改进,二分法在x=0处不可导,故选择平滑的Sigmoid激活函数

$$

\sigma = \begin{cases}

1\quad if \quad x>0 \

0\quad otherwise

\end{cases}

$$

Tanh激活函数

- 投影到(-1 , 1)上,选择$e^{-2x}$时将图像纵坐标方向拉长

$$

tanh(x) = \frac {1-e^{-2x}}{1+e^{-2x}}

$$

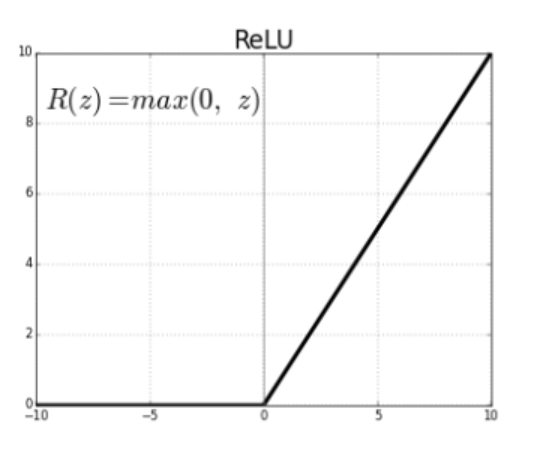

ReLU激活函数

- ReLU激活函数最常用

$$

ReLU=max(x,0)

$$

多类分类

单隐藏层,单分类

-

输入$x\in R^n$

-

隐藏层$W_1\in R^{m\times n},b_1\in R^m$

-

输出层$w_2\in R^{m},b_2\in R$

$h=\sigma (W_1x+b_1)$

$o=w^T_2h+b_2$

$\sigma$是按元素的激活函数

多分类

$$

Y_1,Y_2,…,Y_k=softmax(o_1,o_2,…,o_k)

$$

$$

\sigma o_i = \frac{e^{o^i}}{\sum_{j=1}^{o} e^{o^j}}

$$

-

输入$x\in R^n$

-

隐藏层$W_1\in R^{m\times n},b_1\in R^m$

-

输出层$w_2\in R^{m\times k},b_2\in R^k$

$h=\sigma (W_1x+b_1)$

$o=W^T_2h+b_2$

$y=softmax(o)$

多隐藏层

$h_1=\sigma (W_1x+b_1)$

$h_2=\sigma (W_2h_1+b_2)$

$h_3=\sigma (W_3h_2+b_3)$

$o=W^T_4h_3+b_4$

超参数

- 隐藏层数

- 每层隐藏层的大小