3 线性回归

线性回归

- 应用案例:美国买房

房价预测:系统估价,买入价

成交价是关键因素的加权和:

$$

y=w_1x_1+w_2x_2+w_3x_3+b

$$

w1,w2,w3是权重,b是偏差,权重和偏差的实际值在后面决定 - 给定n维输入

$$

x=[x_1,x_2,…,x_n]^{T}

$$ - 线性模型有一个n维权重和一个标量偏差

$$

w=[w_1,w_2,…,w_n]^T,b

$$

输入是输出的加权和

$$

y=w_1x_1+w_2x_2+…+w_nx_n+b

$$

向量版本:$y=< w,x >+b$ - 线性模型可以看作是单层神经网络

- 比较真实值和预估值,例如房屋的售价和估价

- 假设y是真实值,$/hat(y)$是估计值,我们可以比较

$$

\ell(y,\hat{y})=\frac{1}{2}(y-\hat{y})^2

$$

这个叫做平方损失

训练数据

- 收集一些数据点来决定参数值(权重和偏差),这些数据被称为训练数据,通常越多越好

- 假如我们有n个样本,记

$$

X=[x_1,x_2,…,x_n]^T \quad Y=[y_1,y_2,…,y_n]^T

$$

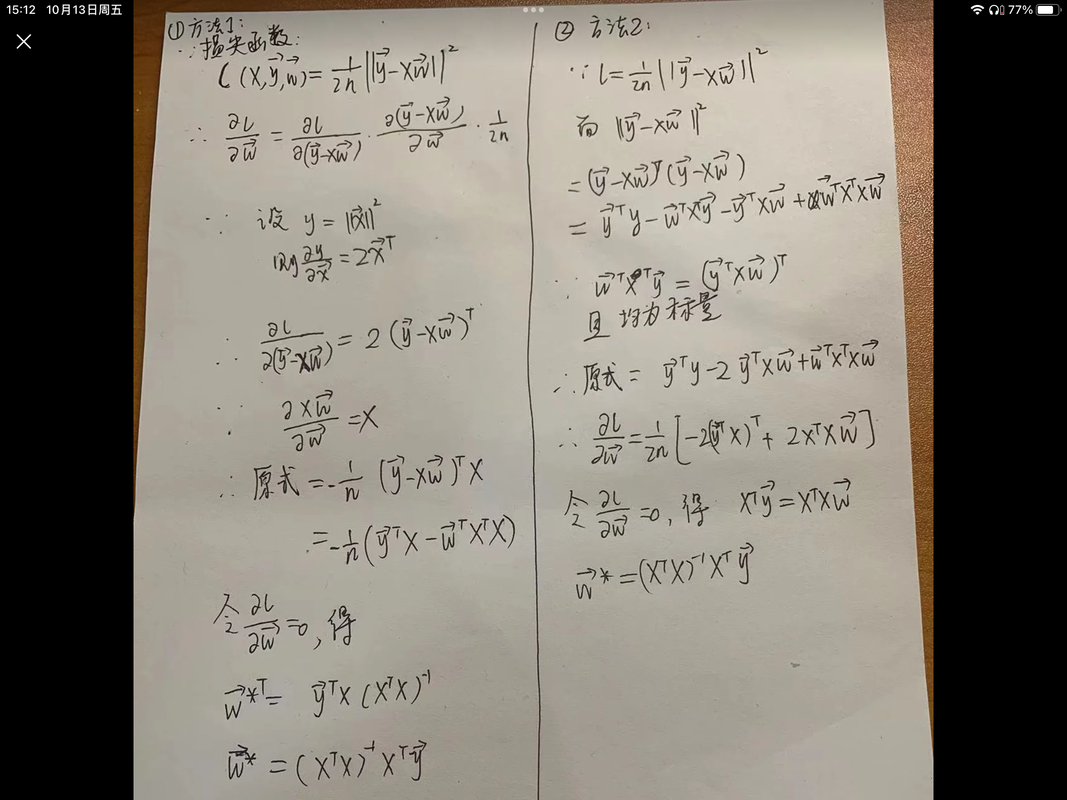

参数学习

- 训练损失,使用平方损失,计算平方损失的均值,$y_i$表示真实值

$$

\ell(X,Y,w,b)=\frac{1}{2n}\sum_{i=1}^{n}(y_i-<x_i,w>-b)^2=\frac{1}{2n}\lVert y-Xw-b \rVert^2

$$ - 最小化损失来学习参数,arg是求当损失函数最小时的参数,通过调节w,b数值来实现

$$

w^,b^=\arg \mathop{\min}\limits_{w,b} \ell(X,Y,w,b)

$$

显示解

评论